NVIDIA Cosmos Reason 2와 Physical AI 완전 가이드

개요

NVIDIA Cosmos Reason 2는 로봇과 자율주행, 영상 분석 에이전트가 실제 물리 세계를 보다 사람처럼 이해하고 추론하도록 돕는 최신 멀티모달 비전-언어 모델(VLM)이다.4 단순히 물체를 인식하는 수준을 넘어, 시간에 따라 사물이 어떻게 움직이고 상호작용하는지까지 고려해 단계별로 문제를 해결하도록 설계된 것이 특징이다.4

Reason 2는 NVIDIA의 Physical AI(물리 세계용 AI) 플랫폼인 "NVIDIA Cosmos"의 핵심 구성요소로, Cosmos Predict·Transfer 같은 세계 생성 모델과 Cosmos Curator·Dataset Search 같은 데이터 처리 도구와 함께 "World Foundation Models(WFMs)" 패밀리를 이룬다.35 개발자는 이 플랫폼을 이용해 로봇 학습, 자율주행 차량 훈련, 대규모 영상 분석 에이전트 등을 더 빠르고 안전하게 개발·검증할 수 있다.135

Cosmos Reason 2는 GitHub·Hugging Face에서 모델을 직접 내려받거나, build.nvidia.com에서 제공되는 호스티드(Hosted) API로 체험할 수 있다.45 이때 업로드한 영상·이미지 데이터는 NVIDIA의 서비스 약관과 신뢰할 수 있는 AI 관련 정책(시스템 카드 등)의 적용을 받으므로, 실제 도입 전에 해당 문서를 반드시 검토하는 것이 중요하다.5

Physical AI와 NVIDIA Cosmos 플랫폼

Physical AI는 로봇, 자율주행 차량, 산업용 카메라 같은 "물리적인 시스템"이 실제 세계를 인식하고, 미래를 예측하며, 그에 따라 행동하도록 만드는 인공지능을 의미한다.135 텍스트 위주의 일반 LLM과 달리, 센서·카메라·라이다 등에서 들어오는 시공간 데이터를 이해하고, 물리 법칙과 상식에 맞게 추론하는 능력이 핵심이다.15

NVIDIA Cosmos는 이러한 Physical AI를 위해 설계된 플랫폼으로, "World Foundation Models(WFMs)"라 불리는 세계 생성·이해용 대규모 모델과, 대규모 센서 데이터 처리·큐레이션 파이프라인을 제공한다.35 개발자 입장에서는 처음부터 방대한 데이터를 수집·학습시키지 않고, Cosmos에서 제공하는 공개(pretrained) 모델과 오픈 데이터셋, 툴킷을 기반으로 자신의 도메인에 맞게 후학습(post-training)만 수행하면 된다.15

또한 Cosmos는 NVIDIA Omniverse, Isaac Sim 같은 시뮬레이션 도구 및 Jetson·Blackwell 기반 하드웨어와 연동되어, "시뮬레이션에서 학습·검증 → 실제 환경 배포"라는 전체 물리 AI 개발 파이프라인을 하나의 생태계 안에서 통합적으로 다룰 수 있도록 설계되어 있다.235

World Foundation Models 구성 요소

Cosmos Predict

Cosmos Predict는 "다음에 무슨 일이 일어날지"를 비디오 형태로 예측하는 세계 생성 모델이다.345 텍스트, 이미지, 짧은 영상 등을 입력받아 최대 약 30초 길이의 물리·시간적으로 일관된 고해상도 영상을 생성하며, 다양한 프레임레이트와 해상도를 지원한다.45

이 모델은 2억 개 이상의 클립으로 사전학습되어 다양한 환경과 상황을 포괄하며, 자율주행·로봇 시뮬레이션에서 보기 힘든 "엣지 케이스"를 대량 생성하는 데 특히 유용하다.45 예를 들어, 드문 악천후·복잡 교차로 상황 등을 리얼하게 합성해 AV(autonomous vehicle) 모델을 극한 상황까지 테스트하는 용도로 활용된다.145

Cosmos Transfer

Cosmos Transfer는 "스타일 변환"에 특화된 멀티컨트롤(world style transfer) 모델로, 하나의 시뮬레이션 또는 구조화된 영상을 다양한 환경·조명 조건으로 확장하는 데 쓰인다.345 세그멘테이션 맵, 깊이 정보, HD 맵, CG 시뮬레이션 비디오 등을 입력으로 받아, 물리적으로 그럴듯한 포토리얼리스틱 영상으로 변환한다.45

이를 통해 CARLA, NVIDIA Isaac Sim 같은 시뮬레이터로 만든 단일 장면을 "야간·우천·눈길·도심·고속도로" 등 서로 다른 조건의 다수 비디오로 증폭시켜, 데이터 부족 문제를 효율적으로 해결할 수 있다.345

Cosmos Reason

Cosmos Reason는 세상(세계)을 "만드는" 모델이 아니라, 만들어진 세계와 실제 센서 데이터를 "이해하고 평가하는" 역할을 담당한다.35 이미지·비디오를 입력받아 물체·장면을 인식하는 것뿐 아니라, 물리 상식과 시간적 흐름에 기반한 체인-오브-쏘트(chain-of-thought) 추론을 수행하고, 그 과정을 텍스트로 설명한다.45

이 모델은 주로 세 가지 용도로 활용된다.

합성 데이터 품질 평가 및 필터링(critic)

로봇·자율주행 정책 모델의 의사결정 보조 및 검증

실시간·오프라인 영상 분석 에이전트의 "두뇌" 역할345

Cosmos Curator와 Cosmos Dataset Search

Cosmos Curator와 Cosmos Dataset Search(CDS)는 Cosmos WFMs가 사용하는 대규모 센서·비디오 데이터셋을 효율적으로 관리하기 위한 데이터 처리 도구들이다.3

Cosmos Curator는 대량의 센서 데이터를 빠르게 필터링·주석(annotate)·중복 제거할 수 있게 해주는 파이프라인으로, 물리 AI 개발에 필요한 정제 데이터셋을 만드는 시간을 크게 단축한다.3 Cosmos Dataset Search는 이렇게 정제된 데이터셋을 대상으로 특정 상황(예: "우천 속 횡단보도에서 보행자 돌발 출현")을 질의해 원하는 시나리오를 빠르게 검색·추출할 수 있도록 지원한다.3

Cosmos Reason와 Cosmos Reason 2의 역할과 특징

세계 이해·추론에서 Reason이 맡는 역할

Cosmos Reason는 Cosmos Predict·Transfer가 만들어낸 합성 영상, 혹은 실제 센서 데이터를 "비평가(critic)"이자 "설명자(explainer)" 입장에서 분석한다.5 예를 들어, 자율주행 시뮬레이션에서 생성된 수많은 장면 중 물리적으로 말이 안 되는 영상이나, 학습에 도움이 되지 않는 장면을 Reason가 텍스트로 설명하며 걸러낼 수 있다.5

또한 로봇이나 자율주행 차량이 어떤 상황에서 어떤 행동을 했는지, 그리고 다른 선택지가 무엇이었는지를 자연어로 해석해 주기 때문에, 사람 개발자가 모델의 의사결정을 이해하고 디버깅하는 데도 중요한 도구가 된다.45 이처럼 Reason는 데이터 큐레이션과 정책 검증, 그리고 런타임 영상 분석까지 물리 AI 파이프라인 전반에서 "추론 엔진" 역할을 수행한다.5

Cosmos Reason 2의 주요 개선점

Cosmos Reason 2는 이전 버전인 Reason 1 대비 정확도를 크게 끌어올렸으며, Physical AI Bench 및 Physical Reasoning 리더보드에서 오픈 모델 중 1위를 기록할 정도로 시각 이해 성능이 높다.4 특히, 공간·시간(spatio-temporal) 이해와 타임스탬프 정밀도가 개선되어, "언제 어디서 무슨 일이 일어나는지"를 더 정확히 표현할 수 있게 되었다.4

모델 크기는 2B와 8B 두 가지 버전으로 제공되어, 엣지 장치(예: 로봇 온디바이스 추론)부터 클라우드 대규모 배치까지 다양한 배포 환경에 맞게 선택할 수 있다.4 또한 Reason 1의 16K 토큰 대비 256K 토큰까지 입력 컨텍스트를 처리할 수 있어, 장시간 비디오나 복잡한 시나리오도 한 번에 분석·요약하는 데 유리하다.4

멀티모달·공간 이해 능력

Reason 2는 단순한 텍스트+이미지 조합을 넘어 다음과 같은 다양한 시각·공간 정보를 처리한다.4

2D/3D 포인트 위치 지정

바운딩 박스 좌표

물체 이동 경로(trajectory) 데이터

영상 내 텍스트 인식(OCR)

이를 통해 "영상 속 특정 시점의 특정 물체 위치를 좌표로 반환"하거나, "로봇 그리퍼가 물체를 집어 옮기는 데 필요한 경로를 JSON 포맷으로 제안"하는 등, 기존 VLM보다 훨씬 구조화된 출력을 제공한다.4 이런 구조화 출력은 로봇 제어, AV 플래너, 영상 분석 파이프라인에 손쉽게 통합될 수 있다는 점에서 실용성이 높다.4

Cosmos WFMs의 주요 활용 분야

Cosmos WFMs는 "데이터 생성·확장 → 세계 이해·추론 → 정책 후학습·검증"이라는 공통 흐름을 가지고, 로봇 학습·자율주행 훈련·영상 분석 에이전트 개발에 모두 활용된다.135

로봇 학습

로봇이 다양한 환경에서 사람처럼 유연하게 행동하려면, 수많은 상황에서의 시각·동작 데이터를 학습해야 한다.13 하지만 실제 로봇으로 데이터를 모으는 것은 비용과 시간이 많이 드는 작업이다.

Cosmos WFMs는 다음과 같은 방식으로 로봇 학습을 가속한다.35

Cosmos Transfer로 시뮬레이션 영상을 다양한 환경·조명으로 변환해 합성 데이터 양을 크게 늘린다.

Cosmos Predict를 로봇 정책에 맞게 후학습(post-train)해 "앞으로 몇 초 동안 세상이 어떻게 변할지"를 예측하는 세계 모델로 활용한다.35

Cosmos Reason가 합성 데이터 품질을 평가하고, 로봇 정책이 얼마나 안전하고 합리적으로 행동하는지 체인-오브-쏘트로 분석한다.35

예를 들어, NVIDIA Isaac GR00T N1.6은 휴머노이드 로봇용 비전-언어-액션(VLA) 모델로, Reason를 활용해 로봇의 맥락 이해와 추론 능력을 강화한다.124 Franka Robotics, NEURA Robotics, Humanoid 등은 이 스택을 이용해 로봇 동작을 시뮬레이션에서 학습·검증한 뒤 실제 하드웨어로 이전하고 있다.12

자율주행 차량 훈련

자율주행 차량 개발에서는 다양한 지형·날씨·교통 상황에서의 센서 데이터가 필수지만, 이런 데이터는 실제 도로에서 수집하기 어렵고 위험할 수 있다.135 Cosmos는 다음과 같은 방식으로 AV 개발을 지원한다.

Cosmos Transfer로 기존 주행 영상을 다양한 날씨·조도·지역 조건으로 확장한다.34

Cosmos Predict로 다중 뷰·멀티센서 환경에서의 미래 프레임을 생성해, 드물거나 위험한 시나리오를 안전하게 시뮬레이션한다.45

Cosmos Reason가 주행 영상에 상세한 타임스탬프 캡션을 달고, 위험 상황이나 중요한 이벤트를 식별해 데이터 검색·분석을 쉽게 만든다.45

예를 들어, Uber는 Cosmos Reason 2를 활용해 자율주행 훈련 데이터에 정확하고 검색 가능한 비디오 캡션을 생성함으로써, 중요한 주행 시나리오를 효율적으로 찾아볼 수 있도록 하는 실험을 진행하고 있다.4 이러한 후학습을 통해 BLEU, VQA, LingoQA 등 다양한 지표에서 의미 있는 성능 향상이 보고되었다.4

영상 분석 AI 에이전트

산업 현장·도시 인프라·보안·안전 모니터링에서는 대량의 CCTV·센서 영상에서 중요한 이벤트를 자동으로 찾고 요약하는 "영상 분석 AI 에이전트"가 점점 중요해지고 있다.13

Cosmos Reason 2는 다음과 같은 기능으로 이러한 에이전트를 고도화한다.345

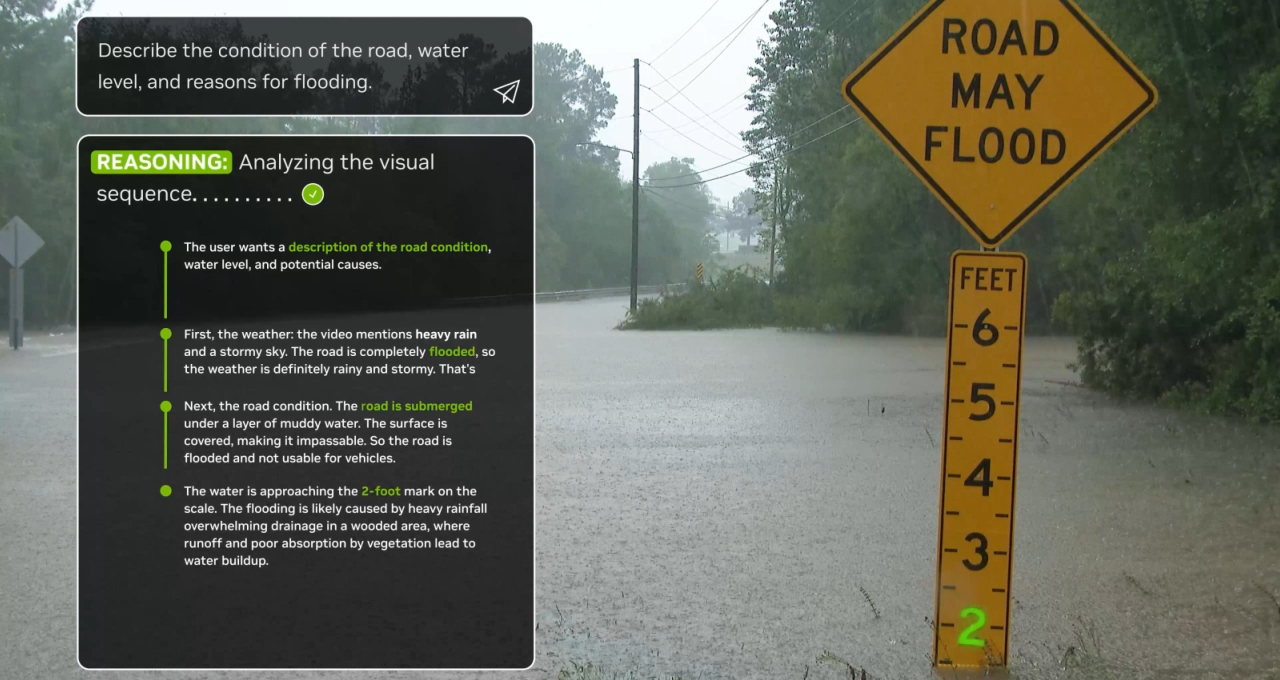

실시간 또는 저장된 영상에 대해 자연어 질의 응답(QA) 수행

장시간 영상을 타임스탬프와 함께 요약해 작업 효율 개선

OCR·바운딩 박스·좌표 인식을 바탕으로 구체적인 위치·객체 정보 제공

NVIDIA는 Cosmos Reason를 NVIDIA Metropolis의 "비디오 검색 및 요약(Video Search and Summarization, VSS)" 블루프린트와 결합해, 대규모 영상 데이터에서 자동으로 검색·요약하는 에이전트를 구축하는 참조 워크플로를 제공하고 있다.13 Salesforce, Milestone, Hitachi, Uber, VAST Data 등은 이런 스택을 활용해 교통·직장 안전·스마트 시티용 영상 AI 에이전트를 개발하고 있다.124

Cosmos Reason 2 무료 API 체험과 데이터·라이선스 개요

Cosmos Reason 2는 Hugging Face에서 모델 체크포인트(2B·8B)를 내려받아 로컬·자체 인프라에서 사용할 수 있으며,4 동시에 NVIDIA의 호스티드 카탈로그(build.nvidia.com)를 통해 브라우저 기반 체험 및 API 호출도 지원한다.45 호스티드 환경에서는 예시 프롬프트와 함께 바운딩 박스·로봇 궤적 출력 등을 시연할 수 있고, 사용자가 직접 이미지·영상을 업로드해 분석 결과를 확인할 수 있다.4

이러한 온라인 체험 시 업로드된 데이터와 생성 결과는 NVIDIA의 서비스 약관(Terms of Service), 개인정보 보호 정책, 그리고 Cosmos 관련 시스템 카드·모델 카드 등 "Trustworthy AI" 문서에 규정된 조건을 따른다.5 NVIDIA는 Cosmos에 대해 윤리·보안·프라이버시 관점의 시스템 카드와 하위 카드(Explainability, Bias, Safety & Security, Privacy 등)를 제공하며, 개발자가 자신의 산업·용도에 맞게 규제·내부 정책 준수 여부를 검토할 것을 권고한다.5

또한 NVIDIA는 Google DeepMind와 협력해 API 카탈로그에서 생성되는 비디오에 워터마킹을 적용하는 등, 생성 콘텐츠의 출처 추적과 안전한 활용을 위한 기술적 장치도 도입하고 있다.5 따라서 기업·연구자는 Reason 2를 서비스에 통합하기 전에, 개발자 포털에 제공된 시스템 카드·모델 카드 및 관련 약관을 꼼꼼히 확인하고, 내부 법무·컴플라이언스 팀과 함께 데이터 처리·보존·재사용 정책을 설계하는 것이 바람직하다.5

Reason 2 모델을 직접 내려받아 온프레미스에서 사용하는 경우에도, 사용자는 NVIDIA가 제공하는 라이선스 및 이용 조건을 준수해야 하며, 특히 민감 정보(PII)·보안 관련 데이터에 Reason 2를 적용할 때는 조직의 보안·프라이버시 기준을 함께 적용해야 한다.5

마무리 정리

NVIDIA Cosmos Reason 2는 기존 비전-언어 모델이 약했던 "물리 세계에 대한 상식적·시공간적 추론"을 강화해, 로봇·자율주행·영상 분석 에이전트의 실사용 가능성을 한 단계 끌어올린 모델이다.134 Cosmos Predict·Transfer·Curator·Dataset Search와 함께 "World Foundation Models" 생태계를 구성하여, 데이터 생성에서 이해·검증, 그리고 실제 배포까지 물리 AI 파이프라인 전반을 포괄적으로 지원한다.35

개발자는 공개 모델과 Cosmos Cookbook 레시피를 활용해 자신만의 도메인에 맞게 Reason 2를 후학습하고, 로봇 계획·AV 데이터 캡션·영상 분석 에이전트 등 다양하게 응용할 수 있다.345 다만, 호스티드 API 체험이든 자체 배포든, 모든 사용은 NVIDIA의 이용 약관과 Trustworthy AI 정책의 적용을 받으므로, 실제 프로젝트에 도입하기 전 관련 문서를 충분히 검토하고 조직의 규제·보안 요구 사항과 정합성을 맞추는 것이 중요하다.5

참고

1NVIDIA Unveils New Open Models, Data and Tools to Advance AI Across Every Industry

2NVIDIA Releases New Physical AI Models as Global Partners Unveil Next-Generation Robots

3Physical AI with World Foundation Models | NVIDIA Cosmos

4NVIDIA Cosmos Reason 2 Brings Advanced Reasoning To Physical AI

5Cosmos for Autonomous Vehicles (AVs) and Robotics Developers | NVIDIA Developer