GLM-4.6와 GLM Coding Plan 한눈에 정리

핵심 요약

GLM-4.6는 200K 컨텍스트, 향상된 코드 작성·추론·에이전트 능력을 가진 범용 LLM으로, 특히 실제 개발 환경에서의 코딩 성능에 최적화되어 있습니다. GLM Coding Plan은 이 모델을 각종 코딩 도구에서 저렴하게 쓸 수 있게 해주는 구독형 패키지입니다.

GLM Coding Plan이란 무엇인가

GLM Coding Plan은 개발자를 위한 유료 구독 상품으로, GLM-4.6를 다양한 코딩 도구에서 집중적으로 활용할 수 있게 합니다.

Claude Code, Cline, Roo Code, OpenCode 등 주요 AI 코딩 도구에서 바로 GLM-4.6를 연결해 쓸 수 있도록 설계되었고, 월 단위 저가 요금으로 많은 호출량을 제공하는 것이 특징입니다.

핵심 목적은 "코딩에 특화된 GLM-4.6를 상시로, 많이, 부담 없이 쓰게 하는 것"이라 이해하면 좋습니다.

GLM-4.6의 위치와 전체 성능 수준

GLM-4.6는 GLM 시리즈의 최신 버전으로, 중국에서 개발된 모델 중 최상위권 성능을 목표로 하고 있습니다.

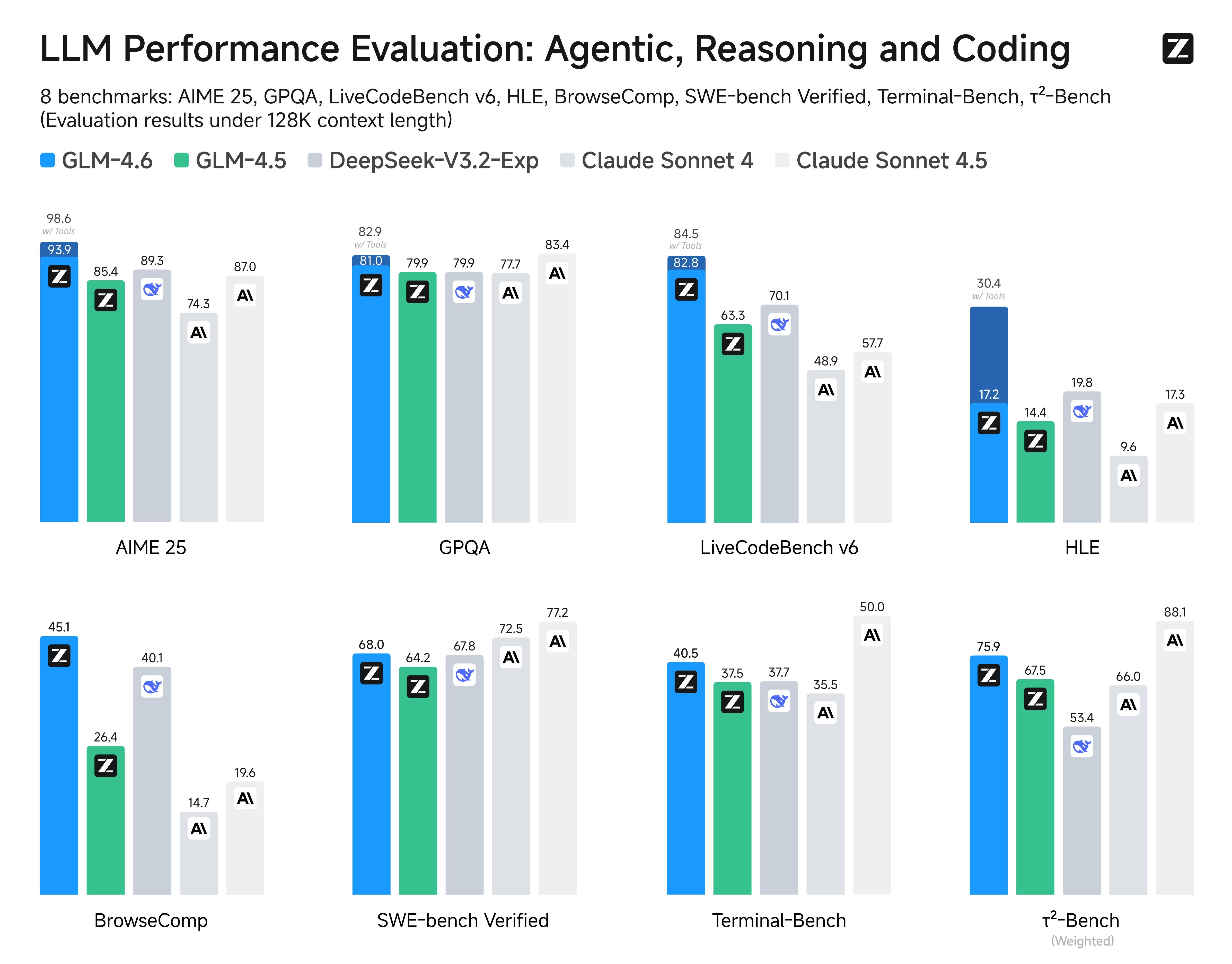

AIME 25, GPQA, LCB v6, HLE, SWE-Bench Verified 등 8개 주요 벤치마크에서 Claude Sonnet 4/4.6와 비슷한 수준의 성능을 보이며, "범용 지능" 측면에서 글로벌 상위 레벨에 올라 있습니다.

이 말은 단순 번역기나 코드 자동완성 수준을 넘어, 복잡한 추론·연구·분석·콘텐츠 생성까지 폭넓게 다룬다는 뜻입니다.

위 그래프는 GLM-4.6가 여러 벤치마크에서 기존 모델들과 경쟁하는 성능을 보여줍니다.

200K 컨텍스트와 최대 출력 길이

GLM-4.6의 컨텍스트 윈도우는 200K 토큰으로, 이전 세대(128K)보다 크게 확장되었습니다.

200K 토큰은 수백 페이지 분량의 문서, 여러 개의 리포지터리, 대형 사양서/기획서 등을 한 번에 넣고 다루기에 충분한 크기입니다.

최대 출력 길이는 128K 토큰으로, 긴 리포트, 소설, 스크립트, 대규모 코드 리팩토링 결과 등도 한 번에 생성할 수 있습니다.

에이전트형 작업(검색→분석→요약→계획 수립처럼 단계가 긴 작업)을 컨텍스트 손실 없이 유지할 수 있다는 점도 큰 장점입니다.

코딩 성능과 실제 개발 환경에서의 강점

GLM-4.6는 알고리즘 문제 풀이나 코드 스니펫 생성 같은 인공 벤치마크뿐 아니라, 실제 개발 툴 안에서의 성능을 중점적으로 튜닝했습니다.

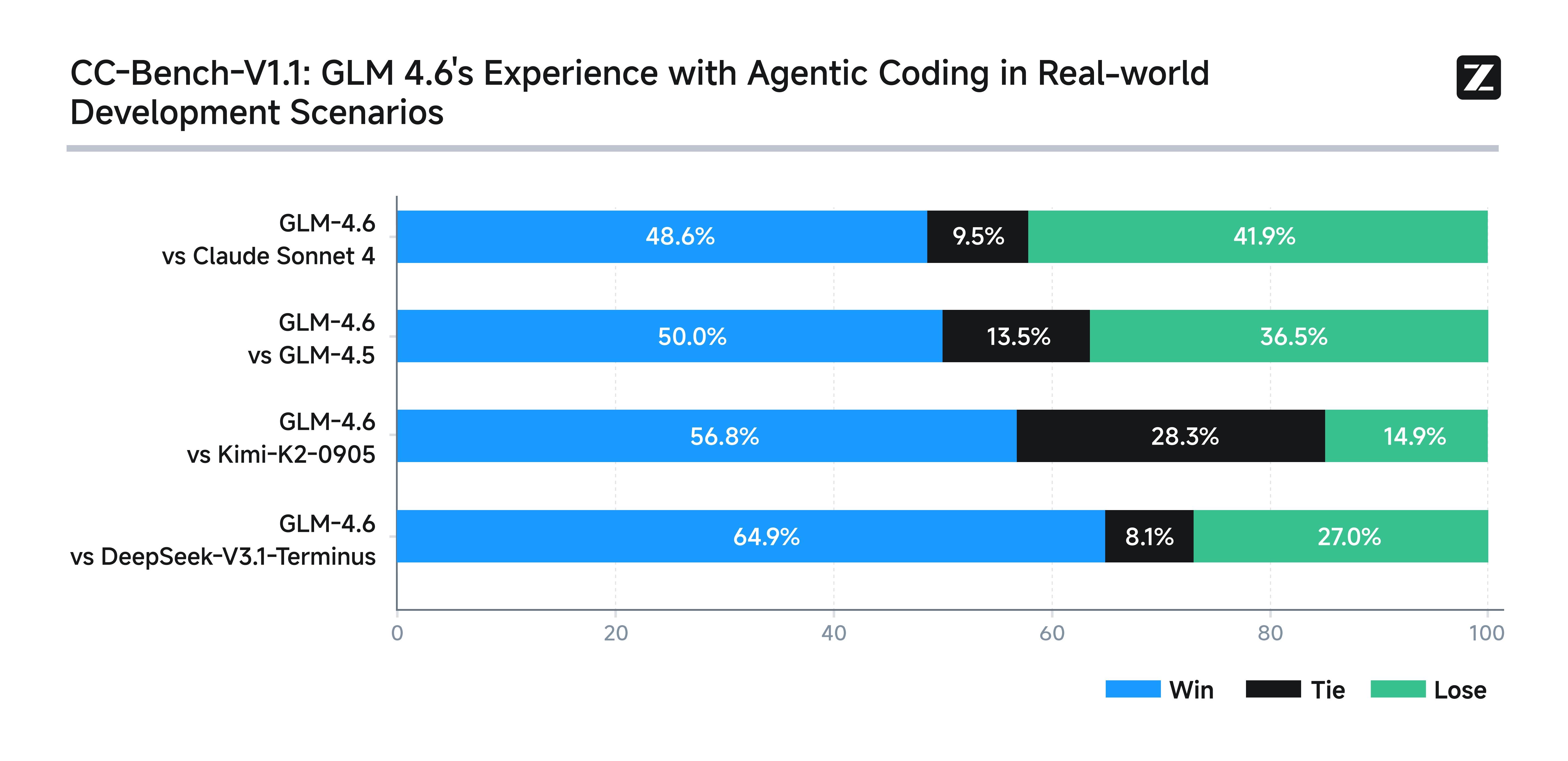

Claude Code 환경에서 74개의 실전형 코딩 태스크를 테스트한 결과, Claude Sonnet 4 및 기타 국내 모델보다 더 높은 성공률을 보였습니다.

프론트엔드 코드에서는 단순히 기능만 구현하는 것이 아니라, 레이아웃·디자인·가독성까지 고려한 "보기에 좋은 UI 코드"를 생성하는 데 강합니다.

위 그림은 다양한 실제 코딩 태스크에서 GLM-4.6가 다른 모델을 앞서는 결과를 시각화한 것입니다.

토큰 효율과 비용 측면의 장점

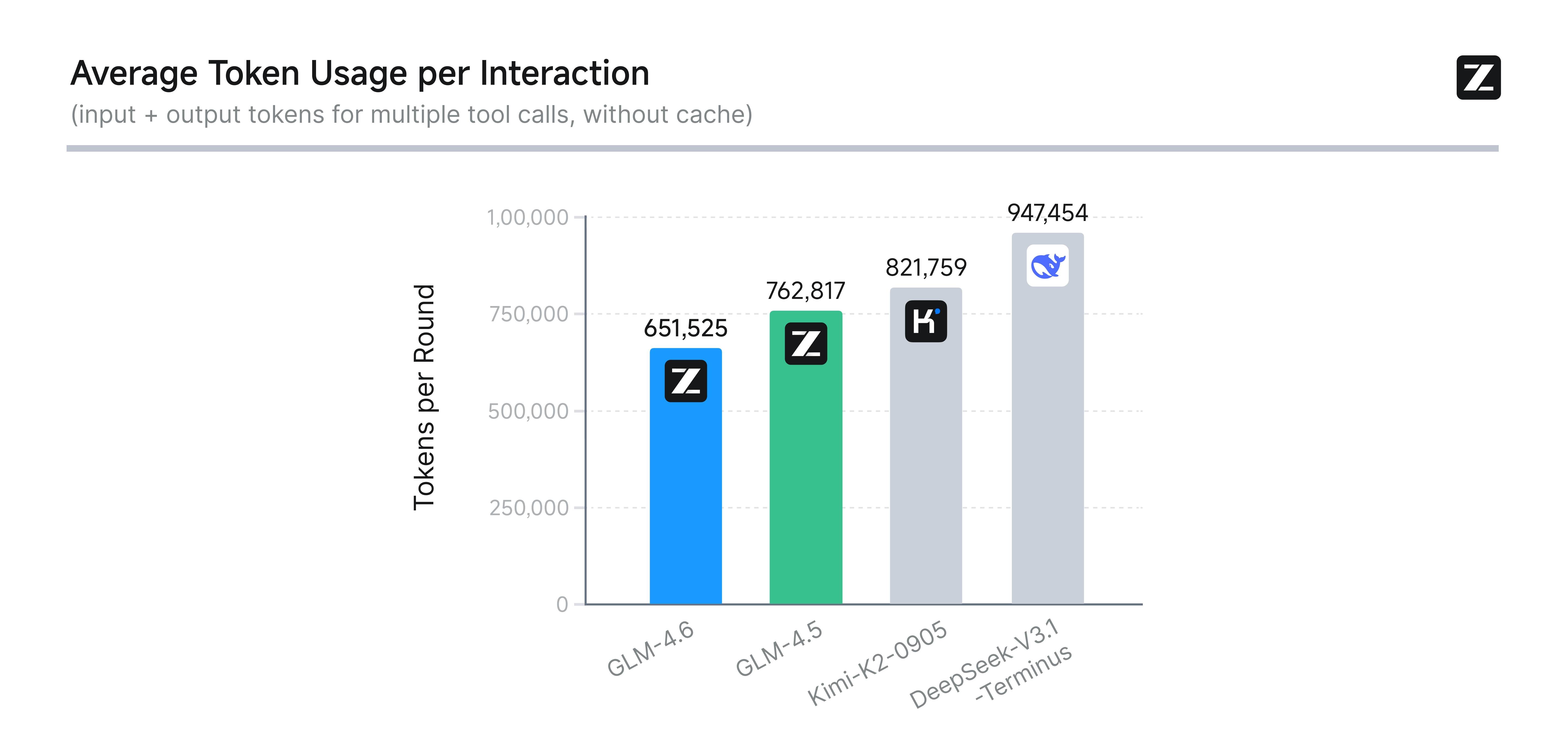

성능뿐 아니라 토큰 사용 효율도 GLM-4.5 대비 약 30% 개선되었습니다.

같은 작업을 수행할 때 적은 토큰으로 해결하므로, 같은 예산으로 더 많은 작업을 처리할 수 있다는 의미입니다.

GLM-4.6는 동급 모델들 중에서도 토큰 소비량이 가장 낮은 수준에 속해, 구독형 코딩 플랜과 결합했을 때 비용 대비 효율이 높게 나옵니다.

위 그래프는 동일 테스트에서 각 모델이 사용한 평균 토큰 수를 비교한 것으로, GLM-4.6의 효율성을 보여줍니다.

또한 테스트에 사용된 모든 문제와 에이전트 실행 경로는 Hugging Face에 공개되어 있어, 벤치마크의 투명성과 재현성이 확보되어 있습니다.

추론·툴 사용·에이전트 성능

GLM-4.6는 단순 Q&A를 넘어 추론(Reasoning)과 도구 활용에 강하게 최적화되어 있습니다.

모델이 스스로 계획을 세우고, 도구(검색, 코드 실행, API 호출 등)를 호출해 결과를 받아 다시 판단하는 "에이전트형" 사용에 잘 맞습니다.

복잡한 업무를 여러 단계로 쪼개고, 필요한 도구를 조합해서 해결한 뒤, 중간 상황에 따라 계획을 수정하는 능력이 강화되었습니다.

이 덕분에 "한 번에 끝나는 답변"보다 "계속 상황을 보면서 일하는 비서/개발 파트너"로 활용할 때 진가를 발휘합니다.

주요 활용 영역 1: AI 코딩

GLM-4.6는 Python, JavaScript, Java 등 주요 언어를 기본적으로 지원하며, 백엔드·프론트엔드·스크립트 작업에 모두 활용할 수 있습니다.

리팩토링, 유닛 테스트 생성, 버그 분석, API 설계, UI 코드 생성 등 코딩 전반에서 "생각 + 구현"을 동시에 도와주는 용도로 적합합니다.

특히 에이전트 모드에서는 "프로젝트 구조 파악 → 수정 포인트 찾기 → 툴 호출(검색/실행) → 코드 수정 제안" 같은 복잡한 작업 시나리오를 자동으로 이끌어갈 수 있습니다.

주요 활용 영역 2: 스마트 오피스와 문서 작업

프레젠테이션(PPT) 제작, 문서 요약, 보고서 초안 작성 등 사무용 작업에서도 강점을 보입니다.

단순히 내용을 나열하는 수준이 아니라, 논리적인 흐름과 시각적 구성을 고려한 아웃라인을 제안해 주고, 슬라이드별 메시지를 정리하는 데 도움이 됩니다.

"내용은 내가 채우고, 구조와 표현은 AI가 다듬는다"는 식으로 협업하면 업무 속도를 크게 높일 수 있습니다.

주요 활용 영역 3: 번역·콘텐츠·버추얼 캐릭터

GLM-4.6는 프랑스어, 러시아어, 일본어, 한국어 등 다수 언어에 대해 번역 품질을 개선했으며, 특히 SNS나 쇼핑몰 설명 등 "딱딱하지 않은 문체"를 자연스럽게 처리합니다.

긴 텍스트에서도 앞뒤 맥락을 유지하며 스타일을 일관되게 유지하기 때문에, 해외 마케팅, 현지화 작업, 장편 콘텐츠 번역에 유리합니다.

소설·시나리오·카피라이팅 등의 창작에서도 감정 톤 조절, 분위기 유지, 인물 성격 일관성 등을 잘 지키려는 방향으로 튜닝되어 있습니다.

또한 다중 턴 대화에서 말투와 태도를 유지하는 능력이 좋아, 브랜드 캐릭터, 버추얼 인플루언서, 고객지원 챗봇 등 "인격을 가진 캐릭터" 구축에도 적합합니다.

주요 활용 영역 4: 지능형 검색과 Deep Research

GLM-4.6는 검색 도구와 연계하여, 단순 링크 나열이 아니라 "검색 결과를 읽고 한 번 더 생각한 요약·분석"을 제공하는 데 최적화되어 있습니다.

사용자의 질문 의도를 더 정교하게 파악하고, 여러 자료를 합쳐 새로운 인사이트를 만들어내는 "Deep Research" 스타일의 답변에 강합니다.

연구·시장조사·경쟁사 분석 등에서 "자료 수집 + 정리 + 비교 + 결론" 전체 과정을 한 번에 맡길 수 있습니다.

GLM-4.6 API 기본 사용법 (cURL 예시)

GLM-4.6는 HTTP 기반의 Chat Completion API로 호출합니다.

가장 단순한 형태의 요청은 다음과 같습니다.

curl -X POST "https://api.z.ai/api/paas/v4/chat/completions"

-H "Content-Type: application/json"

-H "Authorization: Bearer your-api-key"

-d '{

"model": "glm-4.6",

"messages": [

{

"role": "user",

"content": "As a marketing expert, please create an attractive slogan for my product."

},

{

"role": "assistant",

"content": "Sure, to craft a compelling slogan, please tell me more about your product."

},

{

"role": "user",

"content": "Z.AI Open Platform"

}

],

"thinking": {

"type": "enabled"

},

"max_tokens": 4096,

"temperature": 1.0

}'여기서 messages는 대화 이력을 순서대로 전달하는 필드이며, thinking을 활성화하면 내부 추론을 활용한 더 깊은 응답을 기대할 수 있습니다.

max_tokens는 답변 최대 길이를, temperature는 창의성(랜덤성) 정도를 조절합니다.

스트리밍 응답 사용법

응답을 한 번에 받지 않고, 생성되는 대로 실시간으로 받고 싶다면 stream: true를 설정합니다.

curl -X POST "https://api.z.ai/api/paas/v4/chat/completions"

-H "Content-Type: application/json"

-H "Authorization: Bearer your-api-key"

-d '{

"model": "glm-4.6",

"messages": [

{

"role": "user",

"content": "As a marketing expert, please create an attractive slogan for my product."

},

{

"role": "assistant",

"content": "Sure, to craft a compelling slogan, please tell me more about your product."

},

{

"role": "user",

"content": "Z.AI Open Platform"

}

],

"thinking": {

"type": "enabled"

},

"stream": true,

"max_tokens": 4096,

"temperature": 1.0

}'스트리밍은 채팅 UI, 터미널 도구, 코드 에디터 플러그인처럼 "실시간 타이핑되는 느낌"을 주고 싶을 때 유용합니다.

인사이트

GLM-4.6는 "일반 대화도 잘하는 코딩 특화형 범용 LLM"으로 보는 것이 가장 실용적입니다.

개발자는 코딩, 리팩토링, 디버깅, 문서화, 설계 논의까지 한 번에 묶어서 다루는 파트너로, 기획·마케터·PM은 문서 작성, PPT 구조 설계, 번역·현지화에 특화된 도우미로 활용할 때 효율이 극대화됩니다.

실무에 바로 쓰고 싶다면, (1) 기존 개발 워크플로에 AI 코딩 도구를 먼저 연결한 뒤, (2) 긴 맥락이 필요한 작업에서 200K 컨텍스트를 적극 활용하고, (3) 검색·툴 호출 가능한 에이전트 형태로 점진적으로 확장해 나가는 전략이 좋습니다.

출처 및 참고 : GLM-4.6 - Z.AI DEVELOPER DOCUMENT

이 노트는 요약·비평·학습 목적으로 작성되었습니다. 저작권 문의가 있으시면 에서 알려주세요.