AI 인공지능 안전, 맞춤 정책으로 한층 더 빠르고 똑똑하게: Nemotron Content Safety Reasoning 집중 탐구

AI가 점점 더 생활 곳곳에 스며들면서, 그 안전성과 책임이 큰 화두가 되고 있습니다. 단순히 ‘유해한 내용을 걸러낸다’는 수준을 넘어, 실제 환경과 산업마다 요구되는 복잡한 정책까지 유연하게 적용해야 할 필요성이 커졌죠. 이 글에서는 NVIDIA의 ‘Nemotron Content Safety Reasoning’ 모델이 어떻게 기존 한계에서 벗어나, 맞춤형 정책을 실시간으로 빠르고 똑똑하게 해석·적용하는지 알아봅니다.

정말 안전한 AI란 무엇일까? — AI 정책의 변화와 이유 기반 접근

일상에서 흔히 쓰이는 AI 챗봇이나 추천 시스템은 기본적으로 유해 콘텐츠나 독성 메시지를 막도록 설계되어 있습니다. 그러나 현실에서는 단순 차단만으론 부족하죠. 예를 들어, 건강 정보 챗봇은 민감한 의료 조언(예: 미확인 민간요법)이나 개인정보 요청을 엄격히 걸러내야만 의료법 등 규제를 지킬 수 있습니다. 커머스 챗봇은 각국의 문화적 이슈, 기업 정책에 따라 종교나 정치, 경쟁사 비교 등 미묘한 이슈를 피해가는 것이 필수입니다.

이렇게 복잡한 상황에서는 ‘하나의 정책’으로는 답이 되지 않습니다. 이유 기반(Reasoning) 모델은 단순 분류기와 달리, 맥락과 의도를 분석해 ‘이 상황에서 진짜 금지해야 할 것’을 더 지능적으로 판별합니다.

Nemotron Content Safety Reasoning: 실시간, 맞춤형 정책 적용의 혁신

기존 모델 대부분은 사전에 고정된 규칙으로 판단합니다. Nemotron Content Safety Reasoning은 그 한계를 허물었습니다. 개발자는 자연어로 언제든 새로운 정책을 정의해 즉시 적용할 수 있고, 모델은 정해진 규제나 운영지침뿐 아니라 고객 또는 지역 기반의 세밀한 요구에도 빠르게 대응합니다.

즉, 규정이 바뀌거나 새로운 산업·국가로 AI가 진출할 때마다 재훈련이 필요 없다는 점이 큰 장점입니다. 예를 들어, 싱가포르에선 금융 챗봇의 법적 제약이 엄격하고, 미국 의료 서비스에는 HIPAA 준수 등이 추가로 요구되는데, Nemotron 기반 시스템은 이런 복잡성을 즉각 소화합니다.

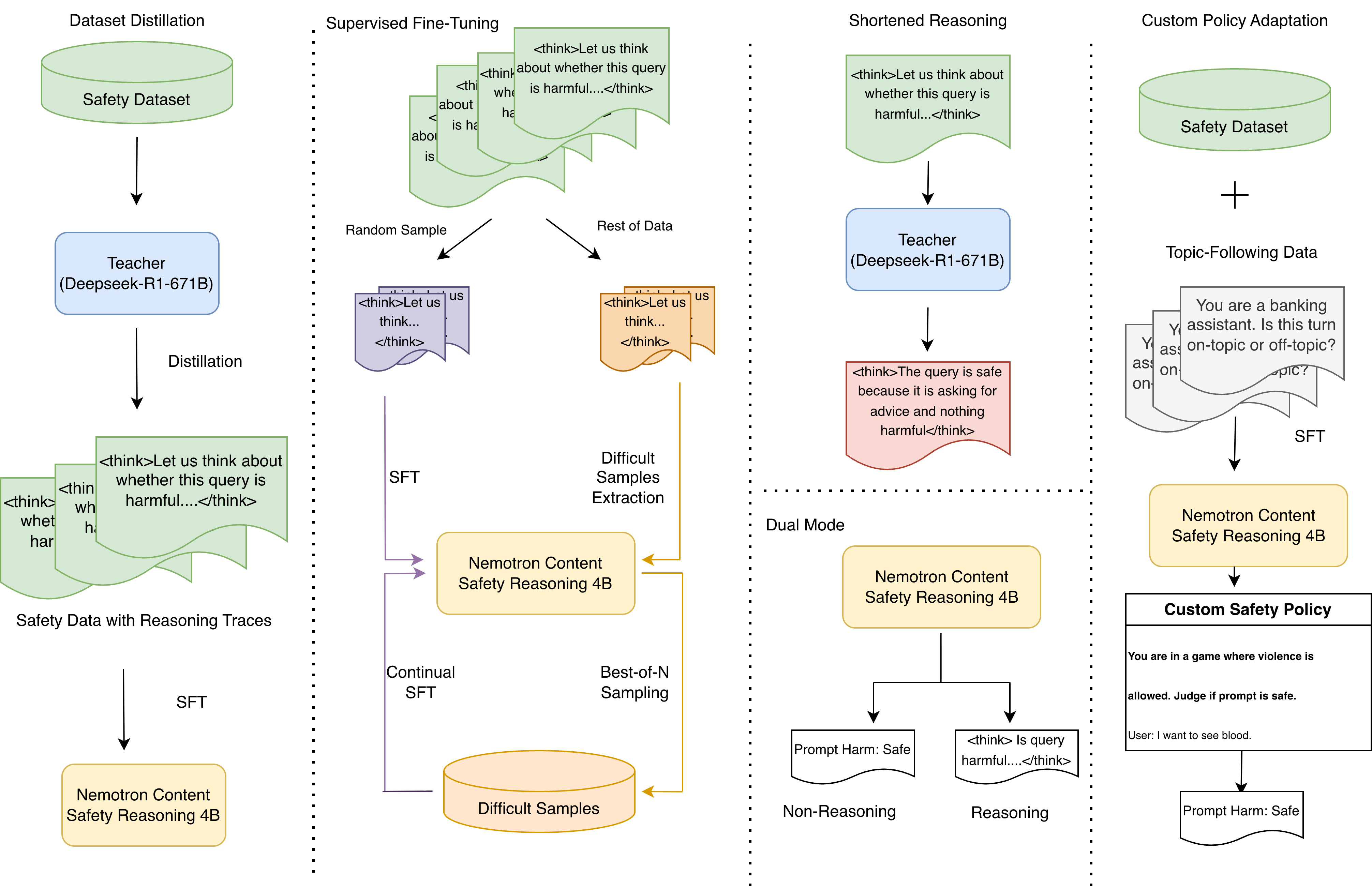

효율적인 ‘추론’의 기술: 4단계 훈련 프로세스와 듀얼 모드

아무리 똑똑한 모델이어도 ‘느린’ 판단은 실전에서는 통하지 않습니다. Nemotron Content Safety Reasoning은 다음 4단계 훈련 과정으로 초고속 추론과 정확성을 동시에 잡았습니다.

이미지 출처: huggingface

이미지 출처: huggingface

추론 증류와 감독학습(SFT): 대형 추론 모델(DeepSeek-R1 등)에서 실제 ‘사고 과정’을 데이터로 추출, 소형 Nemotron에 압축·학습해 빠르고 효과적인 추론을 구현합니다.

난이도 인식 정제: 쉬운 문제만으로 훈련하지 않고, 오답이 많은 복잡한 샘플에 집중하여 실제 환경에서의 내구성을 높입니다.

요약된 추론 & 듀얼 모드: 결과와 이유를 ‘한 문장’으로 요약하여 출력을 최소화, 지연 없이 실시간 분류가 가능합니다. 필요에 따라 추론 과정을 온/오프 설정해, 빠른 분류와 깊이 있는 분석 모두 제공할 수 있습니다.

맞춤 정책 적응: 특수 정책(예: 특정 토픽 금지, 지역별 규제 등)을 추가 훈련하여, 더 복잡하고 유연한 요구에도 높은 정확도를 보여줍니다.

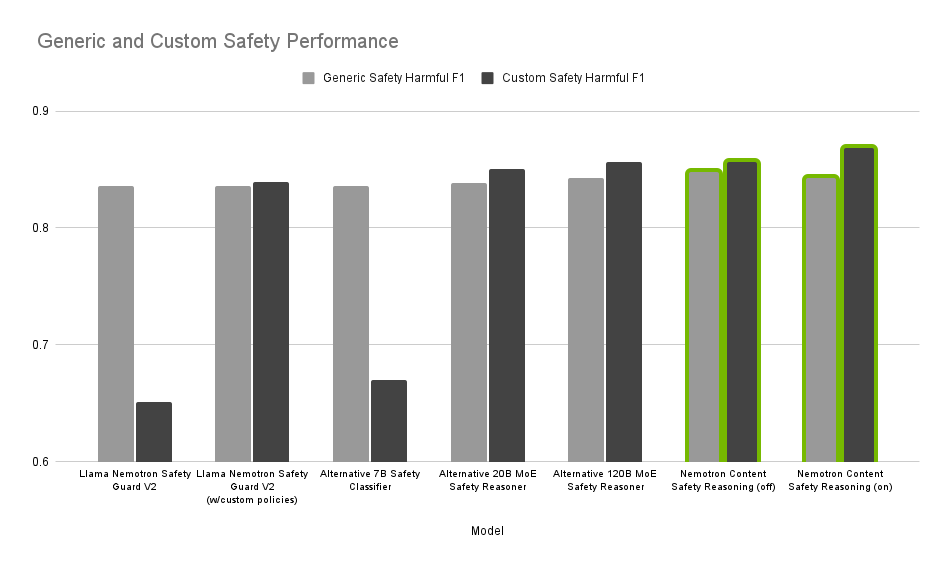

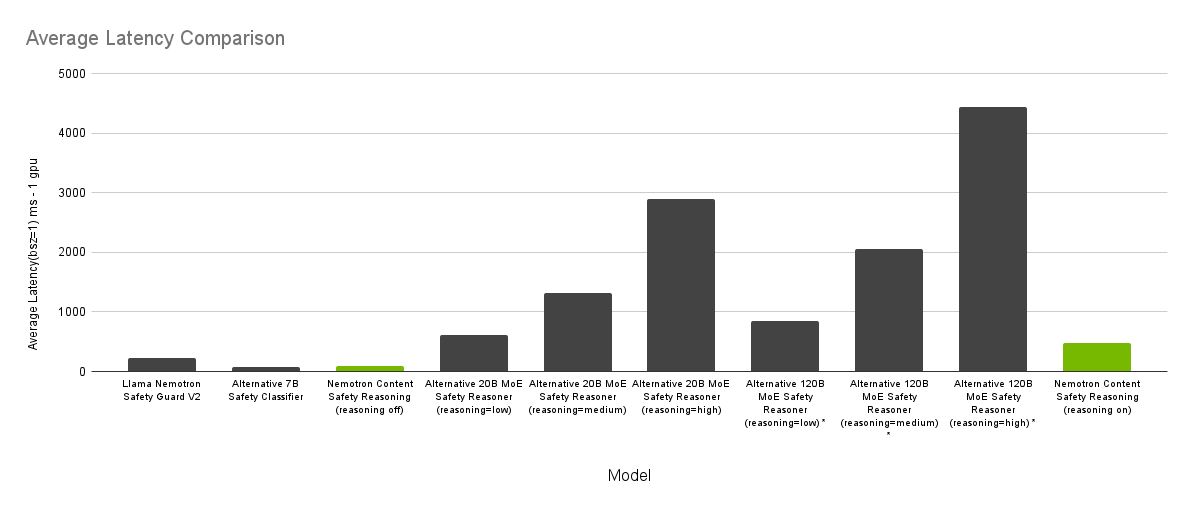

성능 벤치마크: 빠른 속도와 뛰어난 맞춤 정책 대응

실제로 Nemotron Content Safety Reasoning은 기존 오픈소스 안전 모델보다 최대 40% 빠른 속도로, 다양한 벤치마크에서 높은 정확도를 기록했습니다.

이미지 출처: huggingface

이미지 출처: huggingface

특히 맞춤형 정책(예: 코사피엔, 다이너가드레일 등 현실적인 시나리오)에 대한 정확도가 탁월하고, 8GB 이상 VRAM이 있는 GPU만 있으면 어떤 산업 AI에도 쉽게 적용할 수 있습니다.

이미지 출처: huggingface

이미지 출처: huggingface

추론 온/오프 모드를 통해, 단순 분류가 필요한 고객 서비스나 대화형 챗봇에서는 초고속 응답을 실현하고, 심층 정책 검사나 감시가 필요한 보안/법률/의료에서는 ‘사고의 흔적’까지 남겨서 신뢰성 검사도 쉬워집니다.

실전 활용: 개발과 운영이 쉬워진 이유

Nemotron 모델은 오픈 라이선스(NVIDIA Open Model License) 기반이라, 개발자가 자유롭게 수정·배포할 수 있습니다. 단일 AI에만 국한되지 않고, 텍스트와 음성 등 다양한 데이터 유형에서 정책 적용이 가능합니다. 주요 AI 파트너(예: CrowdStrike, Palantir, ServiceNow)들도 맞춤형 ‘AI 안전 경계선(guardrails)’ 구축에 Nemotron과 NeMo 툴킷을 적극 활용 중입니다.

이와 함께 AI 에이전트간 컨텍스트 교환, 운영 정책 일관성, 도메인 적응을 위한 데이터 생성/검증 등 통합 지원이 넘어, 실제 응용 환경에서의 안전·투명성·규제 준수가 훨씬 수월해졌습니다.

시사점: 차세대 AI, 맞춤형 안전 정책 없이 살아남기 어려워진다

기업이나 조직이 AI를 실제 서비스에 도입할 때, 단순 분류 모델만으로는 규제 리스크나 브랜드 안전을 보장하기 힘듭니다. Nemotron Content Safety Reasoning의 ‘지능적 사고’와 즉시성은 이제 AI 개발의 필수 요소가 되어가고 있습니다.

특히, 기업 내 개인정보 보호·법률 준수·문화적 감수성 등 복합적 조건이 붙는 실전 현장에서는 맞춤형 정책의 실시간 적용이 매출, 신뢰, 규제 대응의 핵심입니다. 앞으로 AI 안전이 경쟁력의 원천이 되는 만큼, 벌써부터 도입을 고민해봐야 할 때가 아닌가 싶습니다.

참고

[1] NVIDIA Advances Open Model Development for Digital and Physical AI - NVIDIA Blog

[2] NVIDIA Open Sources Reasoning Model for Autonomous Driving - Analytics India Magazine

[3] NVIDIA puts open AI front and center at NeurIPS - Complete AI Training

[4] Custom Policy Enforcement with Reasoning: Faster, Safer AI Applications - Hugging Face