AI 기반 실시간 음성 간 번역의 혁신: 인공지능이 언어 장벽을 없애다

오늘날 글로벌 커뮤니케이션의 가장 큰 난관 중 하나는 언어 장벽입니다. 하지만 인공지능(AI)이 이를 빠르게 허물고 있습니다. Google의 DeepMind 연구팀 등이 선보인 '실시간 음성 간 음성 번역'(Real-time Speech-to-Speech Translation, S2ST)은 지금껏 상상만 하던 기술을 현실로 만들고 있습니다. 이 글에서는 S2ST가 어떻게 탄생했는지, 어떤 기술적 혁신이 이루어졌는지, 그리고 우리가 일상에서 어떻게 활용할 수 있는지 쉽고 재미있게 풀어드립니다.

실시간 음성 번역, 왜 지금이 혁신의 순간인가?

직업적 미팅, 국제 협상, 여행에서의 소통—우리는 하루에도 여러 번 언어의 벽을 넘고 싶어합니다. 기존 번역 시스템은 말한 내용을 자막이나 번역문으로 처리하지만, 실시간 대화처럼 자연스러운 상호작용을 만들기엔 항상 부족했습니다. 일반적으로 번역까지 4~5초가 소요되고, 번역 중간 단계마다 오류가 누적되며, 목소리의 개성도 사라집니다.

새로운 S2ST 모델은 이 지연을 단 2초로 줄이고, '내 목소리'의 정보까지 보존하는 진짜 실시간 번역을 구현합니다. 덕분에 대화가 훨씬 자연스럽고, 개인의 감정이나 목소리 톤마저 전해지니, 외국인과 대화하는 느낌이 사라집니다.

기존 번역과 S2ST 기술의 차이점은 뭘까?

기존 시스템은 크게 세 단계로 작동합니다:

자동 음성 인식(ASR): 말을 텍스트로 바꿈

자동 번역(AST/MT): 텍스트를 타깃 언어로 번역

텍스트 음성 변환(TTS): 번역문을 다시 음성으로 읽음

이 과정에서 각 단계의 출력이 다음 단계로 넘어가며 오류가 쌓이기 쉽고, 대부분의 시스템은 로봇같은 목소리로 결과를 재생합니다. 특히 수초의 딜레이는 실시간 대화의 매끄러움을 망칩니다.

반면, 최신 S2ST는 한 번에 바로 '소리→소리'로 번역합니다. 모든 처리 과정을 하나로 통합해 데이터가 실시간으로 흐르도록 설계했습니다. 통합된 머신러닝 모델이 오디오에서 오디오로 바로 변환하며, 원래의 화자 목소리를 최대한 살려 냅니다.

AI 번역의 '비밀 소스': 데이터와 모델 아키텍처

이 혁신의 핵심에는 '시간 동기화 데이터 파이프라인'이 있습니다. Google의 엔지니어들은 다양한 언어의 오디오와 번역문을, 각 단어와 구간까지 정확히 일치시키는 고난도 데이터셋을 자동으로 만들어냈습니다. 고급 ASR과 TTS 기술, 그리고 강력한 정렬 알고리즘이 조합되어, 각 언어쌍마다 수십만~수백만 구간의 음성과 텍스트가 촘촘히 맞춰집니다.

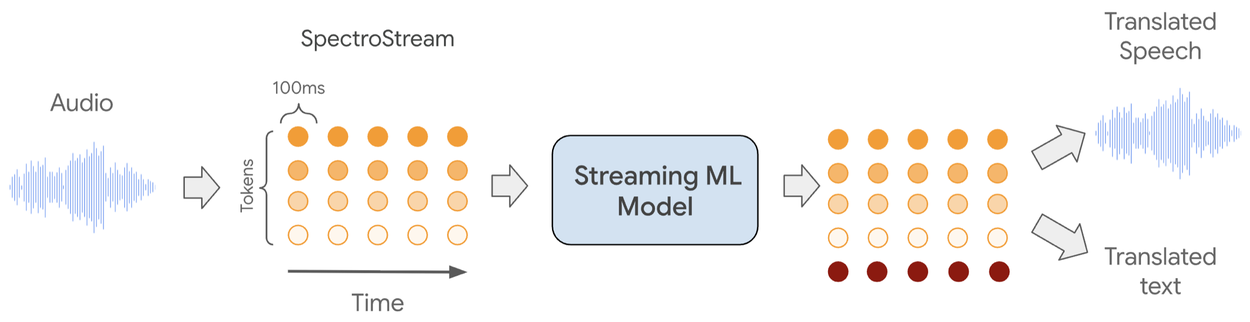

이제 학습된 모델은 오디오를 '오디오 토큰'이라는 2D 배열로 분해해 빠르게 처리합니다. 시간 축을 따라 이어지는 토큰들이 화자의 목소리, 발음, 감정까지 보존될 수 있게끔 설계된 것이 특징입니다.

이미지 출처: googleapis

이미지 출처: googleapis

실제 운용에서, 인공지능은 100ms 단위로 토큰을 예측하면서 매끄러운 실시간 번역을 생성합니다. 2초의 번역 지연은 사용자가 실제 대화에서 거의 느끼지 못할 만큼 짧습니다. 딥러닝 최적화 덕분에 Google Meet이나 Pixel 10 디바이스에서도 바로 적용 가능하죠.

Google Meet과 Pixel 10에서 만나는 실시간 번역

이 AI 번역 시스템은 이미 Google Meet와 Pixel 10에서 본격적으로 사용되고 있습니다. Google Meet에서는 서버에서 처리된 번역이 회의 중 실시간으로 제공되고, Pixel 10은 스마트폰 내부와 클라우드가 함께 동작해 음성 통화, 영상통화 매 순간 개인 맞춤 목소리 번역을 제공합니다.

현재 Google Meet의 S2ST는 영어, 스페인어, 독일어, 프랑스어, 이탈리아어, 포르투갈어 등 5개 언어쌍을 지원합니다. 앞으로는 힌디어 등 다양한 언어로 확대될 예정이고, 더 어려운 문장 구조나 복잡한 어순의 언어에도 적용할 수 있도록 AI 모델의 '문맥 대비 준비시간'도 개선 중입니다.

기술적 도전과 앞으로의 방향

S2ST에서 중요한 관건은 '자연스러운 문장' 생성입니다. 단어 단위 출력이 아닌, 문맥에 맞게 전체 문장을 부드럽게 번역하려면 AI가 좀 더 앞을 내다볼 수 있어야 합니다. 모델은 번역 품질과 실시간성을 동시에 잡기 위해 'Lookahead'라는 미래 예측 시간을 유동적으로 사용하는데, 길수록 품질이 높지만 늦어질 수 있으니 균형이 중요합니다.

또한, 합성음에서 벗어나 사용자의 실제 목소리 스타일까지 보존하는 맞춤형 음성 합성 엔진이 계속 개발 중입니다. 점점 더 자연스럽고, 감정이 느껴지는 번역음성을 만나볼 날이 가까워지고 있습니다.

어디서 활용될까? 일상의 변화를 그려보자

실시간 음성 번역 AI의 등장은 단순히 여행, 미팅, 국제전화뿐 아니라 교육, 의료, 고객센터 등 다양한 현장을 바꿉니다.

국제 화상 회의에서, 모든 참가자가 각자 언어로 자유롭게 토론

스마트폰만 있으면 외국에서 길을 묻고, 레스토랑에서 주문 걱정 끝

교실에서 해외 학생과 실시간 파트너 토론

고객센터 상담, 병원 진료 통역이 즉시 자동으로 지원

이제 '언어'는 더 이상 장벽이 아니라, 연결의 수단이 되어가고 있습니다.

정리 및 실용 조언

AI 기반 실시간 음성 번역은 단순한 자동 번역을 넘어, 개성 있는 목소리와 자연스러운 문장까지 실시간으로 제공합니다. 앞으로 다양한 언어와 더 예술적인 음성 스타일까지 지원할 것으로 기대됩니다. 업무, 여행, 교육, 소통 등 모든 곳에서 이 기술을 활용해 '진짜 대화'를 경험해보세요.

빠르게 변화하는 언어 AI 트렌드를 따라잡으려면, Google Meet와 Pixel 같은 최신 서비스에서 직접 체험해보는 것이 가장 쉬운 시작입니다. 가까운 미래, 더 많은 언어와 기능이 우리의 일상을 혁신하게 될 것입니다.

참고

[1] Google Reveals ‘Secret Sauce’ Behind Its AI Live Speech Translation - Slator

[2] Google DeepMind’s Real-Time Speech-to-Speech Translation: Breaking Language Barriers Instantly - Joshua Berkowitz

[3] Real-time speech-to-speech translation - Google Research