초효율 AI 모델, Gemma 3 270M의 등장과 활용법: 소형 모델의 혁신

AI 모델이 점점 가벼워지고 똑똑해집니다. 구글의 최신 Gemma 3 270M은 초소형 모델임에도 불구하고 강력한 문장 구조화와 인스트럭션 팔로잉 능력을 갖추었어요. 개발자들이 Gemma 3 270M을 활용해 다양한 AI 솔루션을 빠르고 효율적으로 구축할 수 있게 된 비법, 그리고 실제 사례까지 모두 살펴봅니다.

Gemma 3 270M, 무엇이 특별한가요?

Gemma 3 270M은 2억 7천만 개의 파라미터를 지닌 소형 AI 언어 모델로, 크기는 작지만 성능은 결코 뒤지지 않습니다. 170만 개의 임베딩 파라미터와 100만 개의 트랜스포머 블록을 조합해, 드물고 특수한 토큰까지도 자유자재로 이해합니다. 덕분에 한정된 자원에서도 뛰어난 인스트럭션 팔로잉 및 텍스트 구조화 능력을 보여주고, 다양한 언어와 도메인에 맞춤화할 수 있는 기반을 제공합니다.

극강의 에너지 효율과 온디바이스 AI

이 모델의 가장 큰 매력은 에너지 효율입니다. 구글의 자체 테스트에 따르면 Pixel 9 Pro에 탑재해 25번 대화해도 배터리 0.75%만 소모됐어요. INT4 양자화 버전은 저사양 기기, 모바일, 데스크탑에서도 거의 성능 저하 없이 구동 가능해, 프라이버시가 중요한 로컬 AI 적용도 문제없습니다. 작은 인프라로 큰 성능을 내니, 비용 걱정 없이 생산 환경에 바로 적용할 수 있습니다.

특별한 작업에 최적화, 효율을 극대화하는 전략

Gemma 3 270M은 “적재적소” 원칙에 충실합니다. 무거운 범용 모델 대신, 소형 특화 모델로 빠르고 저렴하게 원하는 효과를 냅니다. 예를 들어, 감정 분석, 개체 추출, 텍스트 분류, 규정 준수 체크, 창의적 글쓰기 등 분명한 범위의 대량 작업에 탁월한 효율을 보여줍니다. 짧은 시간 내에 손쉽게 미세 조정(파인튜닝)할 수 있어, 빠른 실험과 배포가 가능합니다.

실제 기업 활용 사례: SK텔레콤의 콘텐츠 모더레이션 혁신

실제로 Adaptive ML과 SK텔레콤은 Gemma 3 시리즈를 활용해 다언어 콘텐츠 모니터링 프로젝트를 성공적으로 완수했습니다. 범용 대형 모델보다, 업무에 맞춘 Gemma 3 4B를 미세 조정한 결과, 훨씬 뛰어난 정확도와 효율을 달성했죠. 이런 전략은 앞으로 더 많은 분야에서 Gemma 3 270M 같은 소형 모델의 실용성을 증명할 것입니다.

창의적 작업까지: 베드타임 스토리 생성 웹앱 사례

작은 Gemma 모델은 비즈니스뿐 아니라 일상적인 창작에도 힘을 발휘합니다. 예를 들어 Transformers.js와 결합해 오프라인에서 구동되는 베드타임 스토리 생성 앱을 제작할 수 있죠. 용량이 작아 웹 기반 서비스, 로컬 프로그램 등에 안성맞춤이며, 사용자의 아이디어를 다양하게 구현하는 데 손색이 없습니다.

Gemma 3 270M이 필요한 순간

이 AI 모델은 다음과 같은 경우에 특히 진가를 발휘합니다.

대량, 반복적이며 명확한 작업이 필요한 경우(예: 감정분석, 정보 추출)

극한의 성능/비용 최적화가 필수일 때(저가형 인프라, 빠른 응답)

데이터 프라이버시가 중요한 온디바이스 환경

빠른 파인튜닝과 배포가 필요한 프로젝트

다양한 특수 모델을 동시에 운영하고자 할 때

쉽고 빠른 시작: 다운로드부터 파인튜닝까지

Gemma 3 270M은 Hugging Face, Ollama, Kaggle, LM Studio, Docker 등 다양한 플랫폼에서 양방향(프리트레인, 인스트럭션 튜닝) 모델을 손쉽게 받으실 수 있습니다. Vertex AI, llama.cpp, Keras, MLX 등 인기 툴에도 바로 적용 가능하고, Hugging Face, UnSloth, JAX를 활용해며 몇 시간 만에 파인튜닝을 완료할 수 있죠. 특화된 모델이 완성되면, 구글 클라우드 런이나 로컬 서버에 곧장 배포하면 끝입니다.

마지막으로, AI 혁신은 크기와 성능의 균형에서 시작합니다. Gemma 3 270M은 소형이지만, 실용성과 효율성, 대응력 모두 대형 모델 못지않아요. 소형 특화 모델을 적극적으로 활용하면 더 빠르고 저렴하며, 창의적인 AI 솔루션 개발의 길이 열립니다. 여러분만의 스마트한 AI 프로젝트에 Gemma 3 270M을 꼭 한번 적용해보세요!

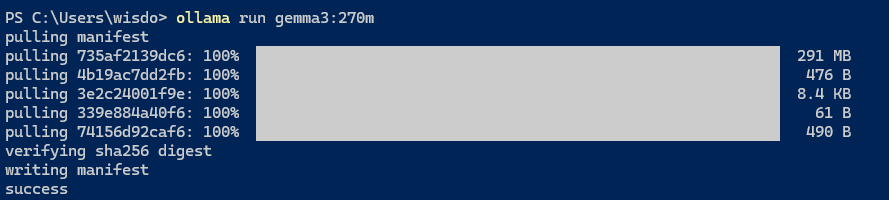

Ollama 설치

ollama run gemma3:270m

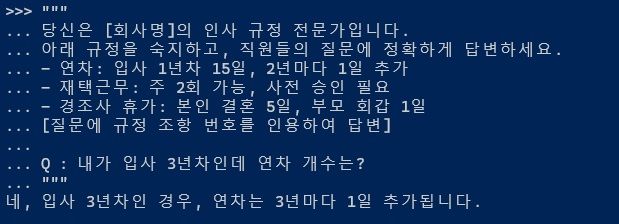

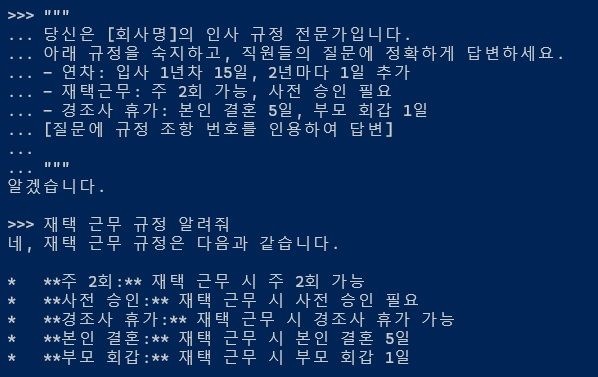

지식은 거의 없다시피 해서 일부 지식을 주고 테스트 해봤다. 인사 규정을 예시로 입력했는데 재택 근무 규정은 맞추고 약간 추론이 필요한 연차 개수는 못 맞췄다.

온 디바이스 급에서 파인튜닝해서 많이 쓸 것 같다. 이제 컴이나 모바일에서 네이티브로 AI 를 돌리는 시대가 왔네.

참고 : Introducing Gemma 3 270M: The compact model for hyper-efficient AI - Google Developers Blog