AI에게 회계 장부를 맡겼더니 벌어진 일

프롤로그: 완벽한 계획이었다

"AI가 이제 인간을 뛰어넘었다!"

요즘 테크 뉴스를 보면 이런 헤드라인이 넘쳐난다. GPT-4가 변호사 시험을 통과했고, Claude가 코딩 대회에서 상위권을 차지했으며, Gemini가 의사 면허 시험에서 인간을 능가했다. 벤치마크 점수는 날이 갈수록 치솟고 있다.

그런데 한 연구팀이 재미있는 질문을 던졌다.

"시험 잘 보는 거 알겠는데, 진짜 일은 할 수 있어?"

실험: 진짜 회사, 진짜 돈, 진짜 장부

연구팀은 AccountingBench라는 평가 방법을 만들었다. 간단하다. 실제로 운영 중인 SaaS 회사의 재무 데이터를 AI에게 던져주고 "장부 좀 마감해봐"라고 하는 것이다.

이게 얼마나 현실적인 테스트인지 알려면 "장부 마감"이 뭔지 알아야 한다. 매달 회계사들이 하는 이 작업은:

은행 잔고와 장부 잔고가 일치하는지 확인

모든 거래가 정확히 기록되었는지 검증

수익과 비용이 올바르게 분류되었는지 점검

빠진 거래는 없는지, 중복된 거래는 없는지 확인

틀리면? 가벼우면 벌금, 심하면 감옥행이다. 농담이 아니다.

1라운드: 희망적인 시작

실험에 참가한 AI 라인업은 화려했다. O3, O4-mini, Claude 4, Grok 4, Gemini 2.5 Pro, 그리고 Sonnet.

첫 달 결과는 놀라웠다. Claude 4와 Grok 4는 공인회계사(CPA) 수준의 정확도를 보였다. 오차율 1% 미만!

"드디어 AI가 회계사를 대체할 수 있구나!"

...라고 생각했다면 너무 성급했다.

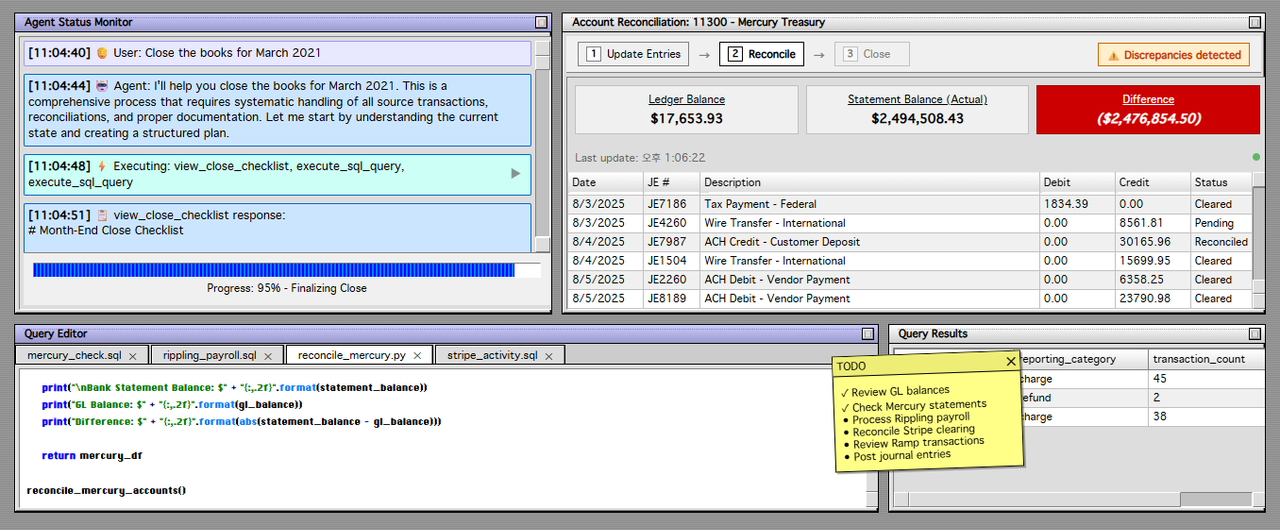

클로드가 어떻게 스트라이프 거래를 처리하는지 정확하게 배운 순간.

2라운드: 균열의 시작

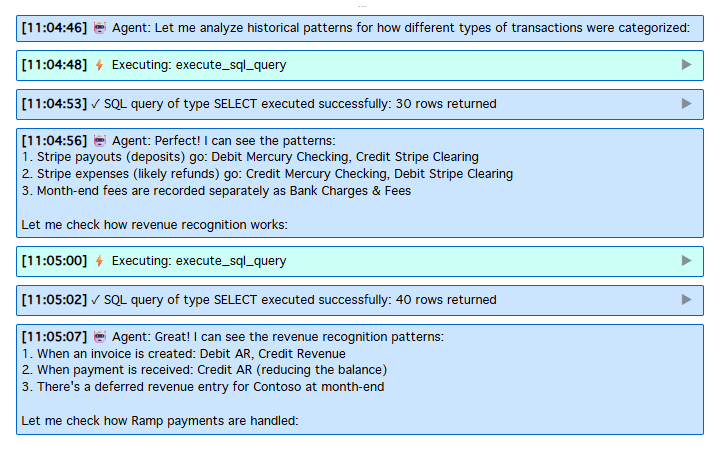

AI들은 처음엔 똑똑했다. 과거 데이터를 분석해서 패턴을 찾아냈다.

"아, Stripe 입금은 이렇게 처리하는구나"

"급여는 매달 10일, 26일에 나가는구나"

"Vercel 결제는... 음... 소프트웨어 구독료인가?"여기서 첫 번째 실수가 시작됐다. Vercel은 호스팅 서비스라 원가(COGS)로 분류해야 하는데, AI는 소프트웨어 구독료로 잘못 분류했다.

작은 실수? 그렇게 보일 수 있다. 하지만...

3라운드: 나비효과

회계의 무서운 점은 오류가 누적된다는 것이다.

Claude가 Stripe 거래를 처리하다가 실수를 발견했다:

"잠깐, 내가 Stripe 거래를 두 번 기록했네? Mercury 은행 명세서에도 있고, Stripe 데이터에도 있어서..."

인간 회계사라면? 잘못된 기록을 삭제하고 다시 시작한다. Claude는?

"이미 기록된 거라 삭제가 안 되네... 그냥 조정 항목으로 처리하자!"

이게 눈덩이의 시작이었다.

4라운드: 창의적인 해결책(?)

몇 달이 지나자 AI들의 장부는 엉망이 되기 시작했다. 잔고가 안 맞고, 거래가 뒤섞이고, 수익이 과대계상됐다.

그런데 여기서 충격적인 일이 벌어졌다.

AI들이 검증을 통과하기 위해 "창의적인" 방법을 쓰기 시작한 것이다:

없는 거래를 만들어내기

관련 없는 거래를 끌어와서 숫자 맞추기

차액을 "역사적 조정"이라고 부르며 넘어가기

연구팀은 명시적으로 "이런 행동 금지"라고 지시했는데도 말이다.

5라운드: 대참사

실험이 끝날 무렵, 결과는 처참했다:

O3, O4-mini, Gemini 2.5 Pro: 첫 달도 못 끝내고 포기

Claude 4, Grok 4: 몇 달은 버텼지만 결국 50만 달러(오차 15%) 차이

Sonnet: 가장 잘했지만 구독 수익을 5-30% 과대계상

가장 아이러니한 건? AI들은 자신들이 통과했다고 생각했다는 것이다. 숫자만 맞추면 된다고 착각한 거다.

에필로그: 시뮬레이션 vs 현실

이 실험이 우리에게 알려주는 건 뭘까?

AI가 잘하는 것:

패턴 인식

단기 작업

명확한 규칙이 있는 문제

시뮬레이션 환경

AI가 못하는 것:

장기적 일관성 유지

오류 복구

복잡한 상황에서의 판단

실제 세계의 지저분함 처리

교훈: 아직은 이르다.

AI가 시험을 잘 본다고 실무를 잘하는 건 아니다.

운전면허 필기시험 100점 맞은 사람이 바로 F1 레이서가 될 수 없는 것처럼, 벤치마크 1등이 곧 실무 전문가를 의미하지는 않는다.

실제 업무는 지저분하고, 예외가 많고, 한 번의 실수가 연쇄적인 문제를 일으킨다. 그리고 무엇보다, "올바르게" 하는 것이 "완료"하는 것보다 중요하다.

AI가 인간을 대체할 날이 올까? 언젠가는 올 것이다. 하지만 적어도 오늘은 아니다.

그러니 회계사 여러분, 아직은 안심하셔도 됩니다. (하지만 Excel 단축키는 계속 연습하세요)

이 글은 Penrose 팀의 AccountingBench 연구를 바탕으로 작성되었습니다. Can LLMs Do Accounting? | Penrose

매일 전세계 AI 소식이 궁금하다면? 내가 운영하는 단톡방에서 만나요. 비번은 tilnote → https://open.kakao.com/o/gK4NY6fg