Realtime API - OpenAI, ChatGPT Advanced Voice Mode의 API 버전

Realtime API

리얼 타임 API는 낮은 지연, 멀티모달 경험을 개발자들이 자신의 앱에 사용할 수 있게 해주는 API 이다. ChatGPT의 Advanced Voice Mode 와 유사한 기능을 사용할 수 있다. 목소리는 미리 지정된 6개의 프리셋을 이용할 수 있다. ChatGPT의 Advanced Voice Mode에서 사용한 동일한 모델의 GPT-4o 모델을 사용한다.

또한 저 지연이 필요 없을 경우 Chat Completions API에서 오디오 인풋을 사용할 수 있다. 이로써 이미지, 텍스트, 오디오 인풋이 가능해 진셈이다.

언어 앱, 교육 소프트웨어부터 고객 지원 경험까지 음성 활용 경험을 고객들과 연결하는데 사용할 수 있다.

Realtime API를 사용하면 위스퍼의 STT 기능, TTS 기능을 통합해서 한번의 API 콜에 사용할 수 있다.

스트리밍을 지원하고 WebSocket 커넥션을 사용한다.

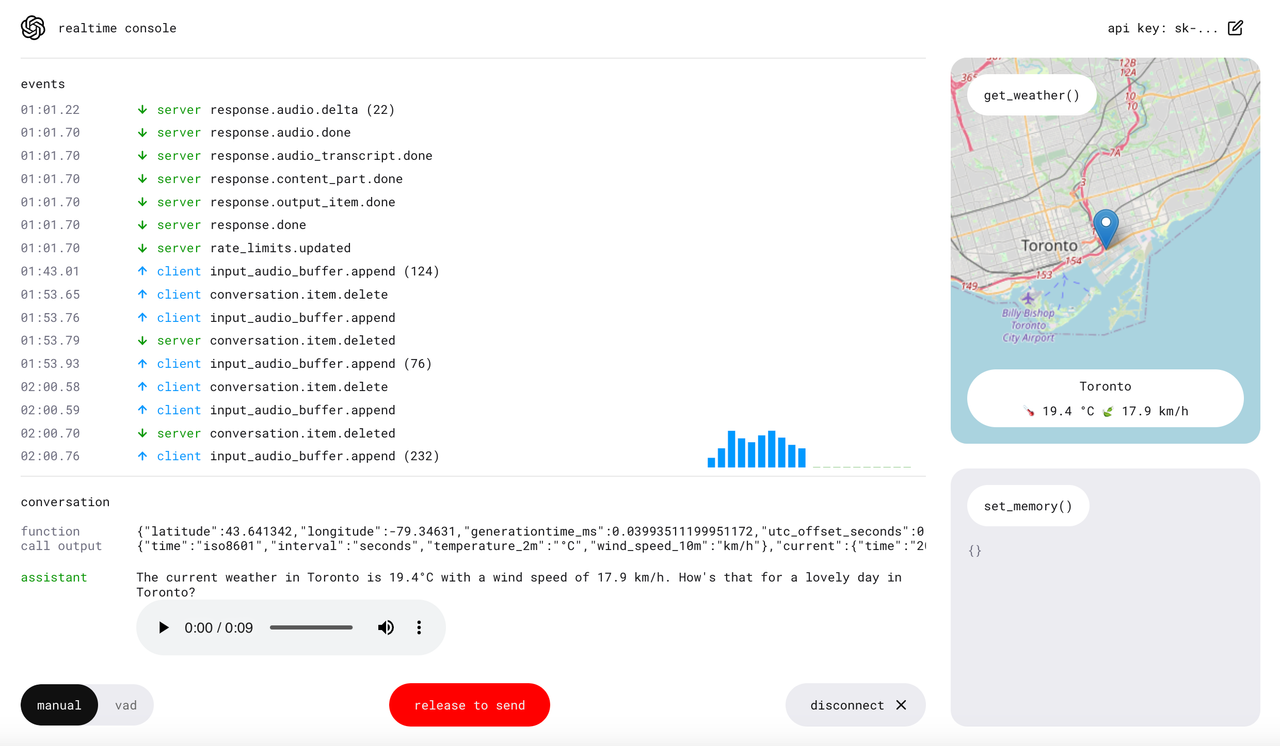

펑션 콜을 사용할 수 있다.

활용 및 가격

오디오 기능은 새로운 GPT-4o 모델인 gpt-4o-realtime-preview 라는 이름으로 제공된다. 채팅 완성에서의 오디오 기능은 gpt-4o-audio-preview 라는 이름으로 몇 주내에 제공된다. 개발자들은 텍스트, 오디오를 인풋으로 놓고 텍스트, 오디오를 아웃풋으로 받을 수 있다.

Realtime API는 텍스트 토큰과 오디오 토큰을 사용한다.

텍스트 인풋 토큰은 1백만 인풋 토큰 당 5달러, 아웃풋 토큰은 1백만 달러당 20달러이다. (현재 gpt-4o의 2배 정도)

오디오 인풋은 1백만 인풋 토큰당 100달러, 1백만 아웃풋 토큰 당 200 달러이다. 이는 인풋의 경우 분당 0.06 달러이고, 아웃풋의 경우 분당 0.24 달러이다. 채팅에서의 오디오 API도 같은 가격이다.

rate limit 은 티어 5가 1000개의 동시 접속이 가능하고, 티어 1~4는 이보다 낮다고 한다. 추후 올릴 예정이라고 한다.

참고 문서 : https://openai.com/index/introducing-the-realtime-api/

리얼 타임 API 사용해 보기 : https://platform.openai.com/playground/realtime

OpenAI에서 제공하는 레퍼런스 클라이언트 코드 : GitHub - openai/openai-realtime-console: React app for inspecting, building and debugging with the Realtime API (realtime api beta, Reference Client - browser and Node.js)

LiveKit과 Agora와 같이 오디오 기능(에코 제거, 소음 제거 등)을 도와주는 도구들을 사용하여 OpenAI는 오디오 관련 기능을 구현한 클라이언트 라이브러리를 만들었음.

또한, Twilio의 음성 API와 OpenAI의 Realtime API를 통합하여 개발자들이 쉽게 AI 가상 에이전트를 만들어, 이 에이전트를 음성 통화에 연결해 고객과 대화할 수 있도록 했다.