Meta SAM 2 - 이미지와 비디오에서 객체를 실시간 세분화하고 편집할 수 있는 오픈소스 모델

Meta SAM 2

Meta Segment Anything Model 2(Meta SAM 2)는 이미지와 비디오에서 객체를 실시간으로 세분화할 수 있는 차세대 모델이다. 이는 지난해 출시된 Meta Segment Anything Model(SAM)의 성공을 바탕으로 개발되었으며, 영상 세분화 능력이 크게 향상된 것이 특징이다. SAM 2는 다양한 실세계 응용 분야에서 탁월한 성능을 발휘하며, 인간의 상호작용 절차를 단축시킨다.

SAM 2의 특징

통합된 세분화 모델

SAM 2는 이미지와 비디오의 실시간 프롬프트 기반 객체 세분화를 위한 첫 통합 모델로, 이미지 세분화 정확도와 비디오 세분화 성능 모두에서 기존의 성능을 능가하는 것으로 평가받고 있다[1]. SAM 2는 사전 적응 없이도 이전에 보지 못한 객체와 시각적 도메인에서도 세분화가 가능하며, 이는 '제로샷 일반화'라고 불린다.

메모리 메커니즘

SAM 2는 비디오의 각 프레임에서 객체의 과거 정보를 기억하여 객체를 정확하게 세분화하는 메모리 메커니즘을 채택하고 있다[4]. 이를 통해 객체의 일시적인 가려짐(occlusion)이나 프레임간 이동 시에도 안정적인 세분화를 제공할 수 있다.

다중 마스크 출력

SAM 2는 세분화 불명확성을 해결하기 위해 여러 개의 마스크를 생성할 수 있다. 예를 들어, 사용자가 자전거 타이어를 클릭할 때, 모델은 타이어뿐만 아니라 전체 자전거도 세분화 대상이 될 수 있음을 인식하여 다중 마스크를 생성한다[3].

SA-V 데이터셋

SAM 2의 훈련에는 SA-V 데이터셋이 사용되었으며, 약 51,000개의 비디오와 600,000개 이상의 마스크를 포함하고 있다[4]. SA-V는 비디오 객체 세분화에서 가장 큰 규모의 데이터셋으로, SAM 2의 성능 향상에 중요한 역할을 한다.

적용 사례

SAM 2는 다양한 실세계 응용 분야에서 활용될 수 있다. 예를 들어, 비디오 편집 소프트웨어에서 특정 객체를 추적하거나 자율 주행 차량의 시각 시스템에서 객체 인식을 수행하는 데 사용할 수 있다. 또한, 형광 현미경 동영상에서 이동하는 세포를 세분화하여 과학 연구를 지원할 수 있다[1].

이미지 및 비디오 편집

SAM 2는 동영상 효과를 생성하고 실시간으로 객체를 추적하는 기능을 통해 비디오 편집 소프트웨어에 혁신을 가져올 수 있다. 이러한 기능은 콘텐츠 제작자가 새로운 창의적인 비디오 효과를 쉽게 적용할 수 있도록 도와준다[3][4].

과학 및 의학 연구

SAM 2는 해양 과학에서 소나 이미지를 세분화하고 산호초를 분석하거나, 위성 이미지 분석을 통해 재난 구호에 기여하는 등 과학 및 의학 연구에서도 널리 사용될 수 있다. 또한, 세포 이미지를 세분화하여 피부암을 탐지하는 데 도움을 줄 수 있다[1][2].

한계와 개선 사항

SAM 2는 강력한 성능을 제공하지만, 몇 가지 한계를 가지고 있다. 예를 들어, 카메라 시점이 크게 변하거나 장시간 가려진 후에는 객체를 추적하는데 어려움을 겪을 수 있다[1]. 또한, 다수의 유사 객체가 밀집된 장면에서는 혼란을 야기할 수 있다. 하지만 모델의 상호작용적인 설계 덕분에 프레임상에서 추가 프롬프트를 통해 이러한 문제를 해결할 수 있다.

데모

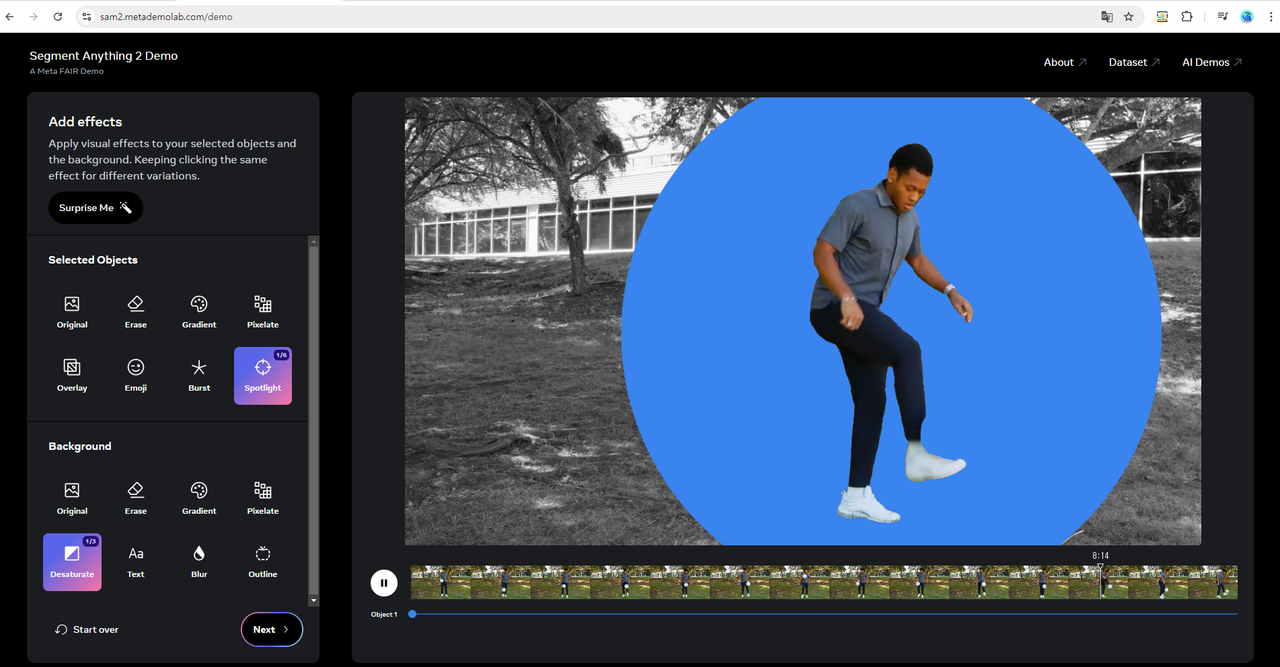

SAM 2 Demo | By Meta FAIR 데모를 꼭 한번 사용해 보세요. 동영상에서 객체를 선택하고 다양한 효과를 줄 수 있습니다. 객체뿐만 아니라 배경에도 효과를 줄 수 있습니다.

동영상 편집할 때도 유용하게 사용할 수 있겠네요. 선택한 부분을 모자이크 하거나 지우거나 효과를 추가할 수 있습니다.

데모에서 비디오를 올리고 편집할 수도 있습니다. 물론 오픈소스이기 때문에 다운로드 받아서 활용하거나 내 서비스에 적용할 수 있습니다.

결론

Meta SAM 2는 이미지와 비디오 세분화에서 새로운 차원을 열어주는 모델로, 다양한 실세계 응용 분야에서 높은 효율성과 정확성을 제공한다. SAM 2의 공개를 통해 AI 연구 커뮤니티는 이 모델을 활용하여 새로운 경험과 사용 사례를 창출할 수 있을 것이다. Meta가 제공하는 오픈 소스 라이선스 덕분에, 이 기술은 더 많은 사람들에게 접근 가능하며, 다양한 산업 분야에서 혁신을 이끌어갈 것이다.

참고 문헌

[1]. SAM 2 소개: 동영상 및 이미지를 위한 차세대 Meta Segment Anything Model

[2]. 새로운 AI 모델은 비디오를 포함한 모든 것을 세분화할 수 있습니다

[3]. SAM 2 데모 | 작성자: Meta FAIR

[4]. SAM2: 이미지와 비디오 모두에 적용 가능한 Segment Anything Model (feat. Meta)